Mới đây, Apple đã tung ra bản cập nhật iOS 13.2 Beta để sửa lỗi cho bản iOS 13.1.1. Phiên bản cập nhật mới nhất này được Apple trang bị thêm một tính năng mới khá hot đối với các tín đồ chụp ảnh đó là chế độ chụp “Deep Fusion”. Hãy cùng xem chế độ chụp mới àny có gì đặc biệt qua bài viết dưới đây nhé!

- Deep fuison là gì?

Bộ ba sản phẩm iPhone 11 đều được cải tiến mạnh mẽ về phần cứng camera. Tuy nhiên, điều đó là chưa đủ để có một bức ảnh đẹp. Các cải tiến về phần cứng camera chúng ta đều có thể nhìn thấy bằng mắt thường: dòng iPhone 11 tiêu chuẩn được bổ sung thêm một ống kính góc siêu rộng (so với camera đơn trên iPhone XR tiền nhiệm), còn bộ đôi 11 Pro và 11 Pro Max được trang bị cụm 3 camera đặt trong một module hình vuông. Các ống kính đều được làm to hơn. Và đêm qua Apple còn giới thiệu một tính năng đột phá khác về phần mềm chụp ảnh mà thậm chí người dùng còn chưa thể nhìn thấy được, bởi nó không được tích hợp cùng những chiếc iPhone 11 mà sẽ được tung ra dưới dạng bản cập nhật phần mềm trên iOS 13.2 sắp tới

Apple gọi tính năng đặc biệt này là “Deep Fusion”, và đây sẽ là một phương pháp thay đổi hoàn toàn cách chúng ta chụp ảnh. Tính năng này hoạt động dựa vào mạng thần kinh (Neural Engine) được tích hợp bên trong con chip Apple A13, sử dụng công nghệ máy học để tinh chỉnh và xử lý tạo ra hình ảnh chất lượng tốt nhất.

Apple gọi tính năng đặc biệt này là “Deep Fusion”, và đây sẽ là một phương pháp thay đổi hoàn toàn cách chúng ta chụp ảnh. Tính năng này hoạt động dựa vào mạng thần kinh (Neural Engine) được tích hợp bên trong con chip Apple A13, sử dụng công nghệ máy học để tinh chỉnh và xử lý tạo ra hình ảnh chất lượng tốt nhất.

2. Tính năng chụp “Deep Fuison” như thế nào?

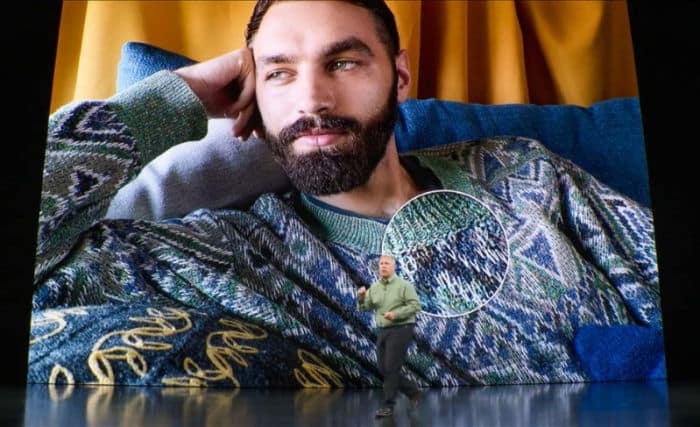

Bức ảnh mà “Deep Fuison” tạo ra có độ chi tiết đáng kinh ngạc, dải tương phản động lớn và độ nhiễu hạt (noise) rất thấp. Tính năng này cho kết quả rõ rệt nhất trong điều kiện ánh sáng từ yếu đến trung bình

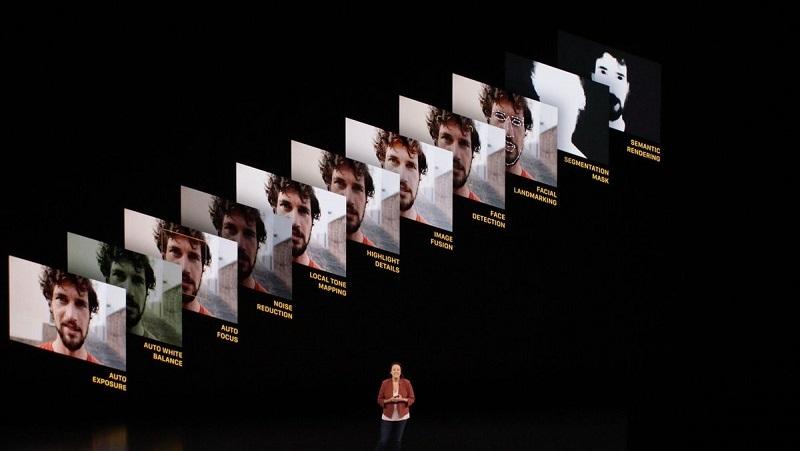

Về cơ bản, Deep Fusion sẽ sử dụng phương pháp chụp tổng cộng 9 bức ảnh theo nguyên tắc: chụp liên tiếp 4 bức ảnh chính (thời gian phơi sáng ngắn) , tiếp đó là 4 khung hình ở tốc độ tiêu chuẩn trước khi người dùng nhấn nút chụp. Sau đó, tính năng này sẽ tạo ra thêm một bức ảnh chụp phơi sáng dài để lấy chi tiết về chiều sâu. Tất cả các bức ảnh sau đó sẽ được ghép với nhau để tạo thành một bức ảnh hợp nhất với chi tiết tốt nhất và ít nhiễu nhất trong bất kỳ điều kiện chụp nào. Công việc này sẽ được làm hoàn toàn bởi trí tuệ nhân tạo và đòi hỏi điện thoại phải có một bộ xử lý AI thật mạnh để xử lý tất cả công đoạn trên trong thời gian tích tắc. Đây cũng chính là điểm mà Apple nói nhiều về bộ xử lý AI mới của họ trên con chip A13 Bionic, với khả năng xử lý 1 nghìn tỷ phép toán trong 1 giây.

Ở bộ đôi iPhone 11 Pro/ 11 Pro Max, Deep Fusion sẽ có 3 tùy chọn xử lý hình ảnh dựa trên mức độ ánh sáng môi trường xung quanh và loại ống kính được sử dụng. Cụ thể, camera chính sẽ sử dụng Deep Fusion trong hai điều kiện ánh sáng trung bình đến ánh sáng phức tạp và khi đó sẽ kết hợp với chế độ chụp đêm Night Mode, giúp tăng chi tiết và giảm nhiễu. Trong khi camera tele sẽ được sử dụng để chụp ở điều kiện ánh sáng cực mạnh. Do đó, trong điều kiện bình thường, Deep Fusion chỉ sử dụng camera chính để xử lý ảnh. Đối với camera góc siêu rộng, hiện tại chưa hỗ trợ Deep Fusion hay Night Mode. Như vậy, phiên bản iPhone 11 tiêu chuẩn sẽ chỉ sử dụng được 2 chế độ tích hợp được Deep Fusion dựa trên camera chính do không có camera tele.

Ở bộ đôi iPhone 11 Pro/ 11 Pro Max, Deep Fusion sẽ có 3 tùy chọn xử lý hình ảnh dựa trên mức độ ánh sáng môi trường xung quanh và loại ống kính được sử dụng. Cụ thể, camera chính sẽ sử dụng Deep Fusion trong hai điều kiện ánh sáng trung bình đến ánh sáng phức tạp và khi đó sẽ kết hợp với chế độ chụp đêm Night Mode, giúp tăng chi tiết và giảm nhiễu. Trong khi camera tele sẽ được sử dụng để chụp ở điều kiện ánh sáng cực mạnh. Do đó, trong điều kiện bình thường, Deep Fusion chỉ sử dụng camera chính để xử lý ảnh. Đối với camera góc siêu rộng, hiện tại chưa hỗ trợ Deep Fusion hay Night Mode. Như vậy, phiên bản iPhone 11 tiêu chuẩn sẽ chỉ sử dụng được 2 chế độ tích hợp được Deep Fusion dựa trên camera chính do không có camera tele.

Với Deep Fusion, công nghệ nhiếp ảnh tính toán hay nhiếp ảnh thuật toán (computational photography) đã thực sự được ứng dụng toàn diện trên iPhone, sử dụng trí tuệ nhân tạo để “bù đắp” những giới hạn về phần cứng camera của điện thoại. Apple cho biết đây là “lần đầu tiên một mạng thần kinh đảm nhận toàn bộ nhiệm vụ xử lý và tạo ra hình ảnh cuối cùng”.

Như vậy, Apple đã chính thức thừa nhận tầm quan trọng của thuật toán trong lĩnh vực nhiếp ảnh smartphone, điều mà Google đã đi “tiên phong” với những mẫu điện thoại Pixel từ trước đó. Hãy cùng chờ đợi bản cập nhật phần mềm 13.2 tới đây để kiểm chứng chế độ chụp “Deep Fusion” có đúng như Apple đã nói không nhé!